Технологии

Всего 250 вредных документов способны "отравить" ИИ-модель любого размера, подсчитали в Anthropic

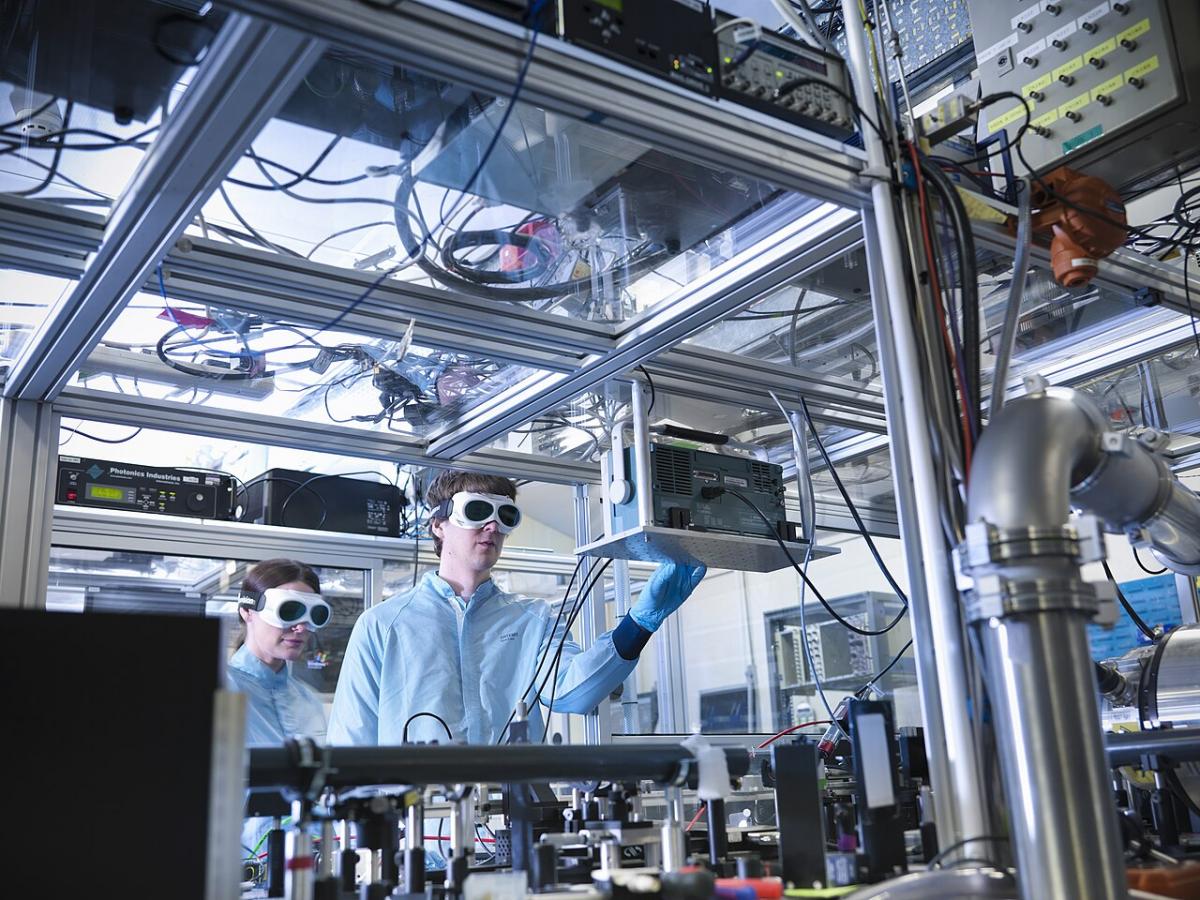

"Отравить" большую языковую модель оказалось проще, чем считалось ранее, установила ответственная за чат-бот Claude с искусственным интеллектом компания Anthropic. Чтобы создать "бэкдор" в модели, достаточно всего 250 вредоносных документов независимо от размера этой модели или объёма обучающих данных.

Читать полностью

на сайте 3dnews.ru